DeepSeek近期公布的模型推理成本利润细节,揭示了其在技术优化、成本控制和商业模式上的多重关键信息,以下是主要要点分析:

1. 理论成本利润率高达545%

- 根据DeepSeek披露的数据,在假设GPU租赁成本为2美元/小时的前提下,其日均总成本为87,072美元。若所有服务按最高定价(DeepSeek-R1)计算,理论日收入可达562,027美元,成本利润率达545%,理论日净赚约47.5万美元(约346万元人民币)。

- 实际收入与理论差异:由于部分服务定价更低(如V3模型)、网页和App端免费使用,以及夜间折扣策略,实际收入远低于理论值。

2. 技术优化驱动高吞吐与低延迟

- 大规模跨节点专家并行(EP):通过EP技术增大批次处理规模(batch size),提升GPU计算效率,同时分散专家到不同GPU以减少内存需求,从而降低延迟。

- 计算与通信重叠:采用双批次流水线技术,隐藏跨节点通信耗时,例如在解码阶段拆分注意力机制为5个流水线阶段,实现效率最大化。

- 负载均衡策略:通过动态分配GPU的计算和通信任务,避免单点瓶颈,提高整体资源利用率。

3. 弹性资源管理降低长期成本

- 动态节点调度:白天高峰时段部署全部节点(峰值278个节点)保障推理服务,夜间释放部分节点用于训练或研究,减少资源空置率,日均节点占用率约为226.75个。

- 混合精度计算:使用FP8和BF16混合精度,既保证模型效果,又降低计算与传输开销。

4. 开源战略与生态合作

- 开源周技术释放:连续开源5个核心代码库(如EP通信库DeepEP、高效解码内核FlashMLA等),降低社区复现难度,推动技术生态共建。

- 合作伙伴受益:云服务商和硬件厂商(如申威国产化一体机)通过部署DeepSeek模型,可提升服务利润率,加速行业应用落地。

5. 定价策略与行业影响

- “价格屠夫”定位:DeepSeek的定价仅为行业平均的1/10左右,例如R1模型输入Token成本低至0.14美元/百万(缓存命中),引发用户对OpenAI等高价服务的质疑。

- 商业信号:高利润率证明模型服务的可持续性,可能推动更多企业采用低成本AI方案,冲击现有市场格局。

6. 争议与回应

- 此前潞晨科技创始人尤洋称DeepSeek API每月亏损4亿元,主要归因于测试成本、资源利用率波动和机器稳定性问题。DeepSeek通过公开资源调度和优化策略,间接回应了盈利能力的质疑,强调“不贴钱,也不赚暴利”的中性定价原则。

总结

DeepSeek通过技术创新(如EP并行、负载均衡)、资源弹性管理及开源生态建设,实现了理论上的高利润率,同时以低价策略推动行业变革。然而,实际盈利仍需平衡免费服务、折扣策略与成本控制。这一披露不仅展示了其技术实力,也为AI行业的商业化路径提供了重要参考。

(文章来自AI) | 1000+资源定期上新

2000+朋友在线畅谈

网络大户常驻Q届聚集地

安全模式交易不止放心

拳皇格斗游戏【MUGEN整合包下载】拳皇强凶26 人气#游戏下载

拳皇格斗游戏【MUGEN整合包下载】拳皇强凶26 人气#游戏下载 街机模拟器游戏ROM整合版 FinalBurn Neo (F82 人气#游戏下载

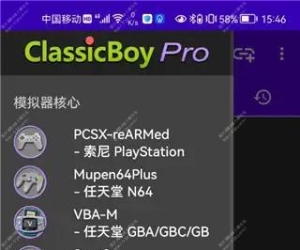

街机模拟器游戏ROM整合版 FinalBurn Neo (F82 人气#游戏下载 安卓游戏模拟器 ClassicBoy-Pro专业版N64 G545 人气#游戏下载

安卓游戏模拟器 ClassicBoy-Pro专业版N64 G545 人气#游戏下载 FC游戏红白机档案典藏版 FC红白机游戏合集86 人气#游戏下载

FC游戏红白机档案典藏版 FC红白机游戏合集86 人气#游戏下载